KI für Ausbilder:innen - Rechtliche Grundlagen

Künstliche Intelligenz (KI) ist dabei, die Lehrlingsausbildung zu revolutionieren. Personalisierte Lernpfade, die sich an das Tempo jedes einzelnen Lehrlings anpassen, automatisierte Erstellung von Übungsmaterial oder intelligente Wissensdatenbanken – die Möglichkeiten sind faszinierend und versprechen eine effizientere und modernere Ausbildung.Doch mit der Begeisterung kommt oft auch die Unsicherheit. Darf ich ChatGPT für die Erstellung von Lehrmaterialien nutzen? Was passiert, wenn die KI falsche Informationen liefert? Und wie stelle ich sicher, dass ich dabei nicht gegen Datenschutz- oder Urheberrechte verstoße?

Viele Ausbilderinnen und Ausbilder stehen vor einem Dilemma. Einerseits wollen sie die neuen Technologien nutzen, um ihre Lehrlinge bestmöglich auf die Zukunft vorzubereiten. Andererseits fühlen sie sich wie in einem rechtlichen Minenfeld.Die Sorge, unwissentlich einen Fehler zu machen, der teure Konsequenzen haben könnte, ist groß. Es klingt alles "vielversprechend, ressourcensparend und attraktiv? Kann es auch sein – mit Betonung auf dem Wort ‚kann‘".

Dieser Artikel ist dein persönlicher Kompass durch den Rechtsdschungel. Wir nehmen dich an die Hand und führen dich verständlich durch die fünf wichtigsten rechtlichen Säulen, die du als Ausbilderin kennen musst: den neuen EU AI Act, die Datenschutz-Grundverordnung (DSGVO), das Urheberrecht, die Haftungsfragen und das Gleichbehandlungsgesetz. Ziel ist es, dir die nötige Sicherheit zu geben, damit du KI nicht nur als Schlagwort siehst, sondern als echten Mehrwert für deine tägliche Arbeit nutzen kannst – selbstbewusst und rechtskonform.

Der EU AI Act: Dein neues Regelwerk für den KI-Einsatz

Die wohl größte und wichtigste Neuerung in der Welt der künstlichen Intelligenz ist der sogenannte EU AI Act. Es handelt sich dabei um das weltweit erste umfassende und staatenübergreifende Gesetz, das klare Regeln für den Einsatz von KI festlegt.Da es sich um eine EU-Verordnung handelt, gilt sie seit ihrem Inkrafttreten am 1. August 2024 direkt in allen Mitgliedsstaaten, also auch in Österreich, ohne dass ein nationales Gesetz dafür nötig wäre.Die einzelnen Bestimmungen treten gestaffelt in Kraft, aber einige zentrale Punkte sind für dich schon jetzt von höchster Relevanz.

The Risk-Based Approach: Why Education is a "High-Risk" Area

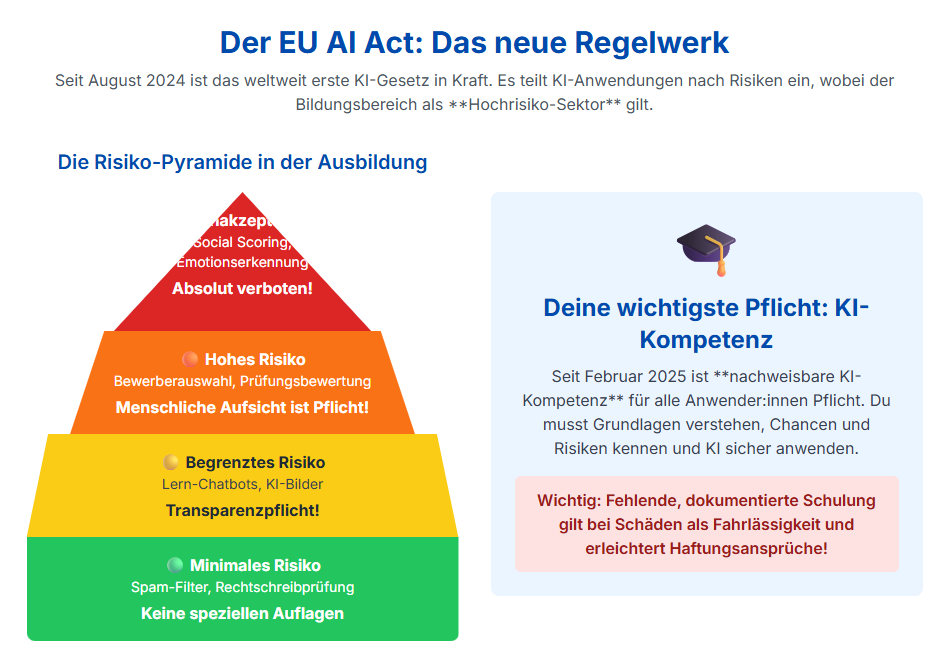

Der AI Act verfolgt einen risikobasierten Ansatz. Das bedeutet: Je höher das potenzielle Risiko einer KI-Anwendung für die Grundrechte, die Sicherheit und die Gesundheit von Menschen ist, desto strenger sind die Vorschriften.Die Verordnung teilt KI-Systeme in eine Risikopyramide ein, die von minimalem bis zu einem inakzeptablen Risiko reicht.

Für dich als Ausbilderin ist eine Klassifizierung besonders wichtig: KI-Systeme, die im Bereich "Bildung und Berufsausbildung" eingesetzt werden, fallen in der Regel in die Kategorie "hohes Risiko".Das gilt insbesondere dann, wenn die KI dazu verwendet wird, den Zugang zu Bildungseinrichtungen zu steuern (z. B. bei der Auswahl von Lehrlingen) oder wenn sie zur Bewertung von Prüfungen und Leistungen herangezogen wird, die für die berufliche Laufbahn entscheidend sind.

Doch keine Panik: "Hohes Risiko" bedeutet nicht, dass der Einsatz verboten ist. Es bedeutet vielmehr, dass du und dein Unternehmen besondere Sorgfaltspflichten erfüllen müsst. Dazu gehören unter anderem ein umfassendes Risikomanagement, die Sicherstellung einer hohen Datenqualität, eine lückenlose technische Dokumentation, hohe Transparenz gegenüber den Nutzern und vor allem eine wirksame menschliche Aufsicht.Du musst also jederzeit in der Lage sein, die Entscheidungen der KI zu kontrollieren, zu verstehen und gegebenenfalls zu korrigieren.

Die folgende Tabelle gibt dir einen praktischen Überblick, wie verschiedene KI-Anwendungen in deiner täglichen Arbeit eingeordnet werden und was das für dich bedeutet:

Risikostufe | Beispiel in der Ausbildung | Deine wichtigsten Pflichten |

Inakzeptables Risiko (Art. 5) | Ein System, das die Emotionen deiner Lehrlinge während einer Schulung in Echtzeit analysiert, um ihre Aufmerksamkeit zu überwachen. | Absolut verboten. Solche Systeme dürfen unter keinen Umständen eingesetzt werden. Verstöße werden mit den höchsten Geldstrafen geahndet, die bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes betragen können. |

Hohes Risiko (Art. 6, Anhang III) | Eine KI, die Bewerbungen für Lehrstellen vorfiltert, die Ergebnisse von Abschlussprüfungen bewertet oder Lehrlinge automatisch bestimmten Lernprogrammen zuweist. | Umfassende Pflichten: Du musst sicherstellen, dass ein Risikomanagementsystem existiert, die Daten fair und repräsentativ sind, alles dokumentiert ist und vor allem, dass immer ein Mensch die finale Entscheidung trifft (menschliche Aufsicht). Hohe Transparenz und Cybersicherheit sind ebenfalls Pflicht. |

Begrenztes Risiko (Art. 50) | Ein Chatbot, der Lehrlingen rund um die Uhr Fragen zu Kursinhalten beantwortet. Ein Tool, mit dem du KI-generierte Bilder oder Videos ("Deepfakes") für Lehrmaterialien erstellst. | Transparenzpflicht: Du musst die Lehrlinge klar und unmissverständlich darauf hinweisen, dass sie mit einer KI interagieren oder dass die gezeigten Inhalte künstlich erzeugt wurden. |

Minimales/Kein Risiko | Der Spam-Filter im E-Mail-Programm der Lehrlinge. Die Rechtschreib- und Grammatikprüfung in einer Standard-Textverarbeitung, die auf KI basiert. | Außer der allgemeinen Pflicht zur KI-Kompetenz (siehe nächster Punkt) gibt es hier keine weiteren spezifischen Auflagen aus dem AI Act. |

Your Most Important New Duty: The "AI Driver's License" (AI-Kompetenz nach Art. 4)

Unabhängig von der Risikostufe einer KI gibt es eine Pflicht, die für absolut jeden im Unternehmen gilt, der mit KI in Berührung kommt: die Pflicht zur KI-Kompetenz nach Artikel 4 des AI Acts. Diese Regelung ist bereits seit dem 2. Februar 2025 in Kraft und verpflichtet Unternehmen, dafür zu sorgen, dass alle Mitarbeitenden, die KI-Systeme entwickeln, betreiben oder auch nur anwenden, über ein ausreichendes Maß an KI-Wissen verfügen.

Das betrifft dich als Ausbilderin ganz direkt. Und es geht noch einen Schritt weiter: Du bist auch dafür verantwortlich, dass deine Lehrlinge die notwendige Kompetenz im Umgang mit den von dir eingesetzten KI-Tools erlangen.

Aber was bedeutet "KI-Kompetenz" konkret? Es geht nicht darum, dass du programmieren lernst. Vielmehr sollst du:

- Grundlagen verstehen: Du solltest wissen, wie KI-Systeme im Prinzip funktionieren.

- Chancen und Risiken kennen: Du musst in der Lage sein, die Potenziale, aber auch die Gefahren und ethischen Fallstricke der eingesetzten Tools einzuschätzen.

- Sicher anwenden können: Du musst die KI-Werkzeuge effektiv und sicher nutzen und wissen, wie du mögliche Schäden (z. B. durch Falschinformationen oder Datenlecks) vermeiden kannst.

Praktisch bedeutet das für dich, dass du dich aktiv weiterbilden musst. Zahlreiche Institute wie das WIFI, ARS, das BFI oder der TÜV SÜD bieten bereits zertifizierte Kurse wie den "WIFI-KI-Führerschein" an, die genau auf diese gesetzliche Anforderung zugeschnitten sind.Es ist entscheidend, dass du und dein Unternehmen diese Schulungen nicht nur durchführt, sondern auch sorgfältig dokumentiert. Diese Nachweise sind im Falle eines Schadensfalls Gold wert, denn sie belegen, dass ihr eurer gesetzlichen Sorgfaltspflicht nachgekommen seid.

Die Verpflichtung zur KI-Kompetenz ist mehr als nur eine bürokratische Hürde; sie definiert einen neuen rechtlichen Standard für die unternehmerische Sorgfaltspflicht.Wenn durch den fehlerhaften Einsatz einer KI ein Schaden entsteht – sei es eine falsche Bewertung eines Lehrlings oder ein Datenschutzverstoß – wird die erste Frage lauten: Wurden die verantwortlichen Personen ausreichend geschult? Kann das Unternehmen keine dokumentierte Schulung nachweisen, wird dies als Verletzung der Sorgfaltspflicht gewertet. Das macht es für Geschädigte wesentlich einfacher, Fahrlässigkeit nachzuweisen und Schadenersatzansprüche durchzusetzen. Deine Rolle als Ausbilderin wandelt sich damit vom reinen Anwender zum zentralen Baustein im Risiko- und Compliance-Management deines Unternehmens.

Datenschutz hat Vorrang: Die DSGVO im KI-Zeitalter

Auch wenn der AI Act viele neue Regeln bringt, eines bleibt unverändert: Sobald personenbezogene Daten verarbeitet werden, hat die Datenschutz-Grundverordnung (DSGVO) immer Vorrang. Der AI Act ergänzt die DSGVO, er ersetzt sie aber nicht.Für den Umgang mit den Daten deiner Lehrlinge bedeutet das, dass du die strengen Regeln der DSGVO weiterhin penibel einhalten musst.

The Golden Rule: No Personal Data in Public AI Tools!

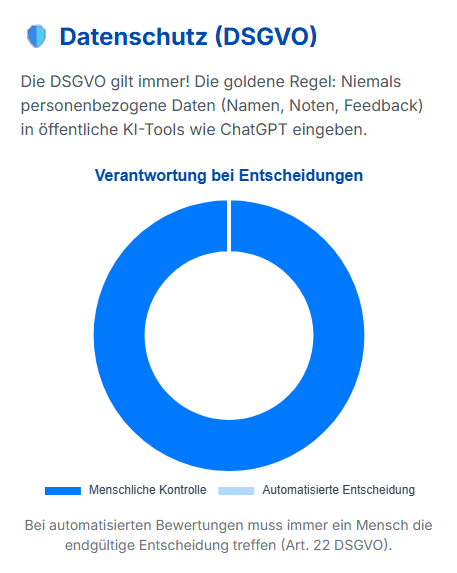

Die wichtigste und unumstößliche Regel für deine tägliche Arbeit lautet: Füttere niemals öffentliche KI-Tools wie die kostenlose Version von ChatGPT mit personenbezogenen Daten deiner Lehrlinge!.Dazu gehören nicht nur Namen oder Geburtsdaten, sondern auch Leistungsbeurteilungen, Feedback zu Projekten, Informationen über Fehlzeiten oder jegliche andere Information, die sich auf eine identifizierbare Person zurückführen lässt.

Warum ist das so kritisch? Wenn du solche Daten in ein öffentliches Tool eingibst, verlierst du die Kontrolle darüber. Die Daten werden an den Anbieter des Tools – oft ein Unternehmen mit Sitz außerhalb der EU, zum Beispiel in den USA – übermittelt und dort für dessen eigene Zwecke, wie das Training zukünftiger KI-Modelle, verarbeitet. Für diese Datenübermittlung und -verarbeitung hast du in der Regel keine gültige Rechtsgrundlage nach Artikel 6 der DSGVO.Du verstößt damit potenziell gegen geltendes Datenschutzrecht, was zu empfindlichen Strafen führen kann.

Während der AI Act den rechtlichen Rahmen für die Zukunft der KI-Nutzung steckt, ist die DSGVO die unmittelbare, praktische Hürde, die den Einsatz vieler populärer Cloud-KI-Tools im Ausbildungskontext stark einschränkt. Die wertvollsten Anwendungen von KI in der Lehre – wie personalisiertes Feedback, die Analyse von Lernfortschritten oder die Erstellung individueller Lernpläne – erfordern zwangsläufig die Verarbeitung personenbezogener Daten. Die naheliegendste Rechtsgrundlage, die Einwilligung des Lehrlings, ist im Ausbildungs- bzw. Arbeitsverhältnis rechtlich heikel, da sie aufgrund des Machtgefälles oft nicht als "freiwillig" gilt. Das bedeutet in der Praxis, dass du als Ausbilderin davon abgehalten bist, identifizierbare Daten deiner Lehrlinge in externe, nicht-konforme KI-Systeme einzugeben.Dies stellt einen erheblichen Engpass dar und zwingt Unternehmen dazu, statt einfacher Standard-Tools in spezielle, DSGVO-konforme Lösungen zu investieren. Das können eigene, geschützte KI-Systeme ("On-Premise") oder Dienste von Anbietern sein, die spezielle Auftragsverarbeitungsverträge (AVV) anbieten, die den strengen europäischen Datenschutzanforderungen genügen. Die Wahl des richtigen KI-Tools wird somit zu einer kritischen rechtlichen und strategischen Entscheidung.

Automated Evaluations? Only with Human Control (Art. 22 GDPR)

Besondere Vorsicht ist geboten, wenn du KI für Entscheidungen einsetzen möchtest, die eine erhebliche rechtliche oder ähnliche Wirkung für deine Lehrlinge haben. Ein klassisches Beispiel wäre eine KI, die automatisch die Prüfung eines Lehrlings bewertet und über Bestehen oder Nichtbestehen entscheidet. Solche vollautomatisierten Einzelentscheidungen sind nach Artikel 22 der DSGVO grundsätzlich verboten.

Die einzige praxistaugliche Lösung im Ausbildungskontext ist, eine bedeutungsvolle menschliche Kontrolle sicherzustellen. Die KI kann dir als wertvolle Assistentin dienen, indem sie beispielsweise eine Vorab-Korrektur durchführt oder auf mögliche Fehlerquellen hinweist. Die endgültige, verantwortliche Entscheidung über die Bewertung muss aber immer bei einem Menschen liegen – also bei dir.Du bist diejenige, die die Entscheidung trifft, begründet und verantwortet.

Urheberrecht: Wem gehören die KI-Bilder und -Texte?

Stell dir vor, du lässt dir von einer KI ein perfektes Bild für deine nächste Präsentation oder einen treffenden Text für ein Handout erstellen. Die Frage, die sich sofort stellt: Darfst du das einfach so verwenden und wem "gehört" das Ergebnis eigentlich?.

No Human Creator, No Copyright

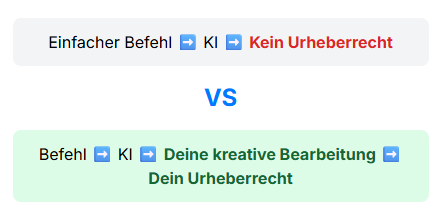

Das europäische und österreichische Urheberrecht ist hier eindeutig: Ein urheberrechtlich geschütztes Werk kann nur von einem Menschen, also einer natürlichen Person, geschaffen werden.Eine KI ist aus rechtlicher Sicht ein Werkzeug, keine Schöpferin. Das hat eine entscheidende Konsequenz: Inhalte, die rein von einer KI auf Basis eines einfachen Befehls (Prompts) generiert werden, genießen keinen Urheberrechtsschutz. Sie sind im Grunde "gemeinfrei", also Allgemeingut.

Das klingt erst einmal gut, hat aber auch eine Kehrseite. Da niemand das Urheberrecht daran hat, kannst auch du keine exklusiven Rechte für dich beanspruchen. Ein anderer Ausbilder oder sogar ein Konkurrenzunternehmen könnte das exakt gleiche Bild generieren und für seine Zwecke nutzen. Wenn du also auf einzigartige Lehrmaterialien Wert legst, sind rein KI-generierte Inhalte möglicherweise nicht die beste Wahl.

The Hidden Risk: The AI's Training Data

Die größte rechtliche Falle im Urheberrecht liegt jedoch nicht im Ergebnis selbst, sondern in dessen Entstehung. Die KI-Modelle wurden mit gigantischen Datenmengen aus dem Internet trainiert. Diese Datensätze enthalten mit an Sicherheit grenzender Wahrscheinlichkeit auch unzählige urheberrechtlich geschützte Bilder, Texte, Musikstücke und Codes.

Wenn das von der KI erzeugte Ergebnis einem dieser geschützten Werke aus den Trainingsdaten zu ähnlich ist, begehst du durch die Verwendung möglicherweise eine unbeabsichtigte Urheberrechtsverletzung.Die prominenten Klagen von Bildagenturen wie Getty Images gegen den Bildgenerator Stable Diffusion oder der New York Times gegen OpenAI zeigen, wie real dieses Risiko ist.

Hier offenbart sich ein grundlegendes Paradoxon bei KI-generierten Inhalten, das du als Ausbilderin verstehen musst: Die Inhalte sind gleichzeitig "kostenlos" (da sie kein eigenes Urheberrecht haben) und "riskant" (da sie das Risiko einer Urheberrechtsverletzung ihrer Trainingsdaten in sich tragen). Die Vorstellung einer mühelosen Inhaltserstellung wird dadurch zu einem Mythos. Sie wird ersetzt durch eine neue Art von Aufwand: den Aufwand der Überprüfung, der Anpassung und des Risikomanagements. Der rechtlich sichere Weg ist nicht die einfache Generierung auf Knopfdruck, sondern die Nutzung der KI als Inspirationsquelle, gefolgt von einer wesentlichen menschlichen, kreativen Bearbeitung, um ein neues, rechtlich eigenständiges Werk zu schaffen.Die "Kosten" für diese "kostenlosen" Inhalte sind also nicht monetär, sondern liegen im Risiko und in der Arbeit, die zu seiner Minderung erforderlich ist.

Your Role as Creator: How to Gain Rights

Der Schlüssel zur rechtssicheren Nutzung und zum Erwerb eigener Rechte liegt in deinem wesentlichen menschlichen Beitrag. Wenn du einen von der KI generierten Text oder ein Bild nimmst und es maßgeblich überarbeitest, verfeinerst, mit eigenen kreativen Ideen anreicherst und in einen neuen Kontext stellst, kann das Ergebnis eine neue, eigenständige Schöpfung sein. An diesem neuen Werk bist dann du die Urheberin, und die KI war lediglich dein Werkzeug.

Checklist for Using AI-Generated Content Safely

- Prüfe die Lizenzbedingungen: Lies immer die Nutzungsbedingungen (AGBs) des KI-Tools. Manche Anbieter räumen dir die vollen kommerziellen Nutzungsrechte an den Ergebnissen ein, andere behalten sich Rechte vor oder verbieten eine kommerzielle Nutzung gänzlich.

- Überprüfe auf Plagiate: Nutze eine Rückwärts-Bildersuche (z.B. Google Lens) für Bilder oder Plagiatsprüfungs-Tools für Texte, um zu sehen, ob das Ergebnis einem bereits existierenden Werk zu ähnlich ist.

- Bearbeite und mach es zu deinem Werk: Je stärker du den KI-Output kreativ veränderst und anpasst, desto geringer ist das rechtliche Risiko und desto eher entsteht ein eigenes, schutzfähiges Werk.

- Vorsicht bei bekannten Elementen: Sei besonders vorsichtig, wenn der KI-Output Logos, Markenzeichen oder erkennbare Personen zeigt. Hier können Marken- oder Persönlichkeitsrechte verletzt werden.

- Sei transparent: Auch wenn es noch nicht für alle Inhalte gesetzlich verpflichtend ist, ist es eine gute Praxis, KI-generierte oder stark KI-unterstützte Inhalte als solche zu kennzeichnen. Das schafft Vertrauen und entspricht dem Transparenzgedanken des AI Acts.

Haftung: Wer ist verantwortlich, wenn die KI Fehler macht?

Die Frage nach der Haftung ist eine der drängendsten, aber die Antwort ist im Grunde einfach und eindeutig: Du bzw. dein Unternehmen seid verantwortlich. Die vorherrschende Rechtsmeinung ist klar: Eine KI ist ein Werkzeug. Die Person oder das Unternehmen, das dieses Werkzeug einsetzt (der "Betreiber"), haftet für die Ergebnisse.Die Ausrede "Das hat die KI gemacht" wird vor keinem Gericht standhalten.

Man kann es mit einem Firmenwagen oder einem gefährlichen Werkzeug in der Werkstatt vergleichen. Wenn du es unsachgemäß bedienst und dadurch ein Schaden entsteht, liegt die Verantwortung bei dir und deinem Arbeitgeber.Ob ein Beratungsfehler von einem menschlichen Ausbilder oder einem KI-gestützten System verursacht wird, ist für die Haftung des Unternehmens unerheblich.

How the AI Act Amplifies Liability

Der AI Act verschärft diese Situation, indem er neue, ganz konkrete Sorgfaltspflichten für den Betreiber eines KI-Systems definiert. Wie bereits erwähnt, ist die Pflicht zur KI-Kompetenz nach Artikel 4 hier der zentrale Punkt.

Stell dir folgendes Szenario vor: Du lässt von einer KI eine Sicherheitseinweisung für eine neue Maschine erstellen. Die KI macht dabei einen gravierenden Fehler, den du nicht bemerkst. Ein Lehrling folgt der falschen Anweisung und verletzt sich. In einem anschließenden Gerichtsverfahren wird die fehlende, dokumentierte Schulung deinerseits (also der Mangel an KI-Kompetenz im kritischen Überprüfen von KI-Inhalten) als klare Fahrlässigkeit gewertet. Dies macht es für den geschädigten Lehrling wesentlich einfacher, den Haftungsanspruch durchzusetzen.

The Professional Duty of Critical Prüfung (Critical Review)

Du musst dir immer bewusst sein, dass KI-Systeme, insbesondere generative Modelle wie ChatGPT, dazu neigen zu "halluzinieren". Das bedeutet, sie können überzeugend klingende, aber komplett erfundene oder falsche Informationen ausgeben.Daher ist es Teil deiner professionellen und rechtlichen Sorgfaltspflicht als Ausbilderin, jeden einzelnen von einer KI generierten Inhalt kritisch zu hinterfragen und auf seinen Wahrheitsgehalt zu überprüfen, bevor du ihn an deine Lehrlinge weitergibst. Du bist und bleibst die letzte Instanz der Qualitätskontrolle.

Das entstehende rechtliche Gefüge, von der Produkthaftungsrichtlinie bis zum AI Act, schafft eine klare Verantwortungskette, die letztendlich die größte und unumgänglichste Haftung beim Endanwender, also bei dir und deinem Unternehmen, platziert. Du bist das letzte, entscheidende Glied in dieser Kette. Während der Entwickler das Werkzeug bereitstellt, bist du es, die es auswählt, den Befehl eingibt, das Ergebnis validiert und es im Ausbildungskontext einsetzt. Ein Versäumnis in einem dieser Schritte – wie das Nicht-Überprüfen von Fakten oder das Fehlen der Kompetenz, Risiken zu erkennen – ist eine Pflichtverletzung, die weitaus direkter und einfacher nachzuweisen ist als ein grundlegender Fehler im Design der KI selbst. Deine Handlungen stehen somit im Zentrum der Haftungsfrage.

Fairness by Design: Gleichbehandlung und KI

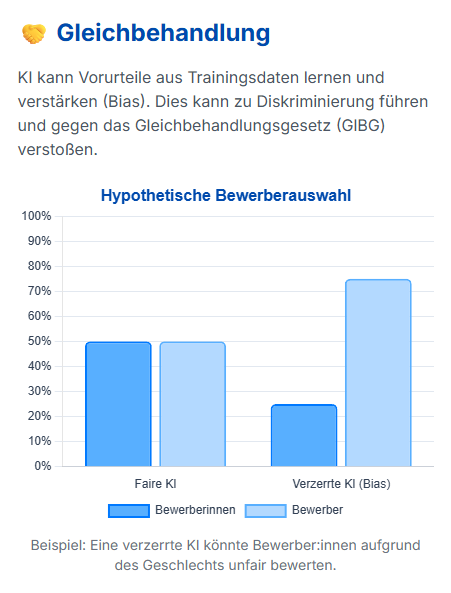

Eines der größten Risiken beim Einsatz von KI ist die Gefahr der unbewussten Diskriminierung durch algorithmische Voreingenommenheit (Bias). Eine KI ist nur so gut und fair wie die Daten, mit denen sie trainiert wurde. Wenn diese Daten historische, gesellschaftliche Vorurteile widerspiegeln – zum Beispiel, dass in der Vergangenheit bestimmte Berufe eher von Männern ausgeübt wurden –, dann wird die KI diese Muster lernen und unweigerlich reproduzieren und sogar verstärken.Sie könnte dann beispielsweise die Formulierungen in der Bewerbung eines männlichen Kandidaten positiver bewerten als die einer weiblichen Kandidatin, einfach weil sie dieses Muster aus den Trainingsdaten gelernt hat.

Connecting to Austrian Law: The Gleichbehandlungsgesetz (GlBG)

Der Einsatz einer solchen voreingenommenen KI bei der Auswahl oder Bewertung von Lehrlingen wäre ein klarer Verstoß gegen das österreichische Gleichbehandlungsgesetz (GlBG).Dieses Gesetz verbietet jede Form der Diskriminierung aufgrund des Geschlechts, der ethnischen Zugehörigkeit, der Religion, des Alters oder der sexuellen Orientierung in der Arbeitswelt.

Der AI Act unterstreicht diese Gefahr, indem er KI-Systeme in den Bereichen Beschäftigung und Bildung explizit als "hohes Risiko" einstuft – gerade weil hier das Potenzial für Diskriminierung und die Verletzung von Grundrechten besonders groß ist.

Die Verwendung einer voreingenommenen KI zur Bewertung von Lehrlingen setzt dein Unternehmen einem doppelten rechtlichen Risiko aus. Zum einen verstößt es gegen die verfahrenstechnischen Anforderungen des AI Acts, der vorschreibt, dass Hochrisiko-Systeme fair, transparent und mit hochwertigen, repräsentativen Daten betrieben werden müssen.Ein Versäumnis hier ist ein direkter Verstoß gegen den AI Act. Zum anderen verstößt ein diskriminierendes Ergebnis gegen das materielle Recht des Gleichbehandlungsgesetzes, das ein Recht auf diskriminierungsfreie Behandlung garantiert.Das Unternehmen riskiert somit Sanktionen nach dem AI Act und eine Schadenersatzklage nach dem GlBG.Dieses doppelte Risiko macht die Vermeidung von Bias von einer ethischen Empfehlung zu einer zwingenden rechtlichen Notwendigkeit.

Practical Steps for Fair AI Use

- Hinterfrage deine Werkzeuge: Wenn du ein KI-Tool für Bewertungsaufgaben evaluierst, frage den Anbieter gezielt, welche Maßnahmen er zur Vermeidung von Bias ergriffen hat. Sei skeptisch gegenüber "Black-Box"-Systemen, deren Funktionsweise nicht nachvollziehbar ist.

- Menschliche Kontrolle ist unverzichtbar: Bei jeder wichtigen Beurteilung eines Lehrlings darf die KI nur eine unterstützende Rolle spielen. Die endgültige Entscheidung muss immer von einem Menschen getroffen werden, der Fairness, Kontext und Empathie in die Waagschale werfen kann.

- Fokus auf objektive Kriterien: Definiere klare, transparente und objektive Bewertungskriterien. Die KI sollte dann dazu dienen, die Leistung anhand dieser Kriterien zu messen, anstatt subjektive Urteile zu fällen.

- Schaffe Einspruchsmöglichkeiten: Stelle sicher, dass Lehrlinge einen klaren und einfachen Weg haben, eine Entscheidung anzufechten, insbesondere wenn sie das Gefühl haben, von einer KI-gestützten Bewertung unfair behandelt worden zu sein.

Fazit: Dein Kompass für die KI-gestützte Ausbildung

Der Einsatz von Künstlicher Intelligenz in der Lehrlingsausbildung ist kein ferner Zukunftstraum mehr, sondern bereits heute Realität. Die rechtlichen Rahmenbedingungen mögen auf den ersten Blick komplex und einschüchternd wirken, aber sie folgen im Kern einfachen und nachvollziehbaren Prinzipien. Sie sind nicht dazu da, Innovation zu verhindern, sondern um sie in sichere und faire Bahnen zu lenken.

Wenn du deine Reise in die KI-gestützte Ausbildung planst, orientiere dich an drei Leitsternen, die dich sicher ans Ziel bringen:

- Kompetenz: Sorge dafür, dass du und deine Lehrlinge geschult seid. Verstehe die Werkzeuge, die du einsetzt, kenne ihre Stärken und Schwächen und dokumentiere eure Lernfortschritte.

- Datenschutz: Behandle die Daten deiner Lehrlinge mit höchster Sorgfalt. Die goldene Regel lautet: Keine personenbezogenen Daten in öffentliche KI-Systeme.

- Kritische Aufsicht: Vergiss niemals, dass du die Expertin bist. Die KI ist dein Co-Pilot, aber du sitzt am Steuer. Jedes Ergebnis, jede Empfehlung und jede Bewertung der KI muss von dir kritisch geprüft und verantwortet werden.

Wenn du diese Grundsätze beherzigst, kannst du die enormen Potenziale der Künstlichen Intelligenz selbstbewusst und verantwortungsvoll nutzen. Du schaffst damit nicht nur eine modernere und effektivere Ausbildung, sondern bereitest deine Lehrlinge auch bestmöglich auf eine Arbeitswelt vor, in der der souveräne Umgang mit KI eine Schlüsselkompetenz sein wird. Die Zukunft der Ausbildung ist da – und du hast nun die Landkarte, um sie sicher zu navigieren.